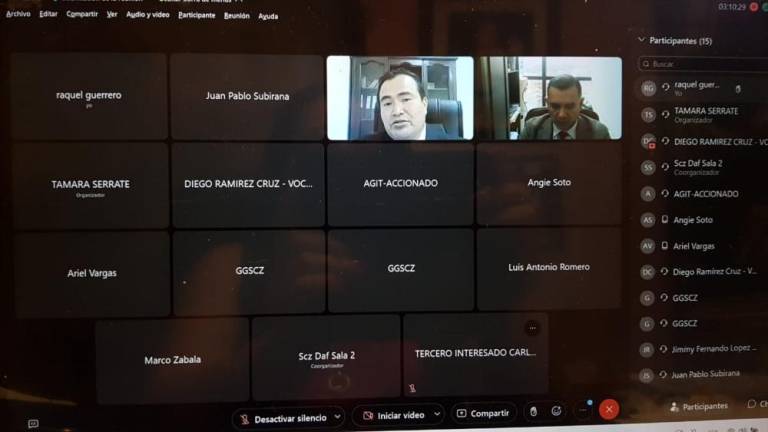

Los vocales de la Sala Constitucional Cuarta del Tribunal Departamental de Justicia de Santa Cruz pusieron una computadora para que el ChatGPT responda.

Tres periodistas independientes de Santa Cruz fueron juzgados este lunes por la vía penal y con “inteligencia artificial” del sistema ChatGPT consultada por dos vocales Jimmy López Rojas y Diego Ramírez Cruz de la Sala Constitucional Cuarta del Tribunal Departamental de Justicia de Santa Cruz. Los trabajadores de la prensa observaron que no se haya tomado en cuenta la Ley de Imprenta y que se haya suscitado un hecho tan “inusual”.

Los periodistas juzgados este 17 de abril son: Marco Zabala, Ariel Vargas y Alberto Ruth, en un caso en que una víctima de violencia decidió retractar su denuncia contra un exfuncionario de Gobierno y acusó a los periodistas por violación de la privacidad.

“Estamos asombrados por lo que paso, porque ya empezó un amedrentamiento, una persecución a los periodistas, acá en Santa Cruz, y lo están haciendo de tal manera que no es juzgarnos por la Ley de Imprenta, sino por la vía penal. Nos sorprendimos nosotros porque no era la Ley de Imprenta, pensamos que los vocales lo iban a rechazar, pero no solo no rechazaron, sino que jugaron consultando a la inteligencia artificial”, expresó Zabala en un contacto con Página Siete Digital.

Asimismo, Zabala señaló que luego del cuarto intermedio en que los vocales deberían deliberar, se colocó una computadora en la cual se hicieron las consultas a al sistema del ChatGPT que resolvió las sanciones que se deberían aplicar, algo que fue calificado como “histórico” por los vocales.

“Volvieron y dijeron que iban hacer algo que nunca se vio en la justicia boliviana, que iban a hacer historia consultándole a la Inteligencia Artificial cuales son las sanciones que nos tienen que dar y pusieron una computadora, donde un robot responde, como preguntándole a Google, cuál es la sanción que tienen que dar, y mediante eso nos sancionaron. Nos quedamos asombrados, pensábamos que era una broma lo que estaba pasando”, relató.

La abogada de los periodistas, Raquel Guerrero, lamentó que no se hubieran valorado otros elementos en la audiencia de acción de privacidad, como la protección a la imagen de la víctima que denunció violencia y el espacio que se le dio a esa denuncia, aunque ella se hubiera retractado luego.

“El hecho es una acción de privacidad que ha presentado una víctima de violencia doméstica, que ha sido golpeada por su pareja supuestamente, les contacta a los periodistas para que pongan su foto, ellos acceden a esta publicación, luego creo que ella se abuena con su pareja y al otro día ya la víctima pide que retiren su foto. Ellos responsablemente, salvaguardando la imagen de la víctima publicaron partes de su foto, no así todo, sino las partes golpeadas, y en la publicación no ponen el nombre completo del agresor”, manifestó.

En las capturas de la audiencia de los periodistas se observa como el ChatGPT define que “la divulgación de fotos de partes del cuerpo de una mujer en las redes sociales, por los medios de prensa y sin su consentimiento o autorización, es una violación de la privacidad y la dignidad de la persona”.

Y en consecuencia resuelve: “Es posible que el Tribunal de Garantías ordene el borrado o baja de estas imágenes para proteger los derechos fundamentales de la mujer afectada. Es importante tener en cuenta que la eliminación de estas imágenes no implica una censura o una restricción injustificada del derecho a la información. El Tribunal de Garantías debe evaluar cuidadosamente las circunstancias del caso y equilibrar los derechos en juego, y si se concluye que la eliminación de las imágenes es necesaria para proteger los derechos de la mujer afectada, entones esta medida sería justificada y proporcionada”.

Fuente: Página Siete